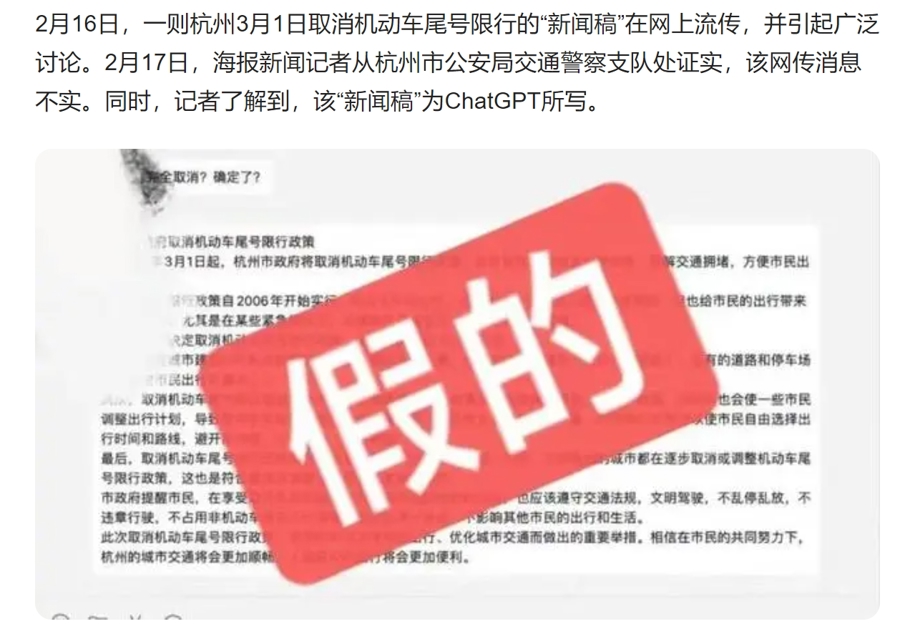

据纽约时报报道,一名律师在法庭案件中使用 ChatGPT 来进行法律文献检索。在此案中,原告的律师提交的法律文件中引用了一些不存在的案例来支持自己的诉求。当航空公司的律师发现这些错误时,立即通知了法庭。法庭于是对此进行了调查。

其中一名原告的律师,史蒂文・施瓦茨表示,他在这次案件中使用 ChatGPT 进行了检索,但并没有意识到检索结果可能是虚假的,因为他之前从未使用过人工智能进行法律研究。检索结果中的某个案例名为 “Varghese 针对南方航空有限公司”, ChatGPT 表示这个案例是真实的,并可以在一些法律数据库,如 LexisNexis 和 Westlaw 中找到。但是,这个案例实际上是不存在的,而且经调查发现, ChatGPT 还造出了另外 6 个不存在的案例。

随后,Levidow, Levidow & Oberman 律师事务所的彼得・洛杜卡和史蒂文・施瓦茨将出席一个纪律听证会,以解释他们为什么会使用 AI 工具来撰写法律文件,并为提交虚假材料道歉。

此事件引发了公众对于使用人工智能工具进行法律研究时可能存在的潜在风险的讨论。虽然 ChatGPT 可以方便地搜索大量相关的法律案例,但它并不是一个完全可靠的来源。因此,在使用 AI 工具时,需要谨慎评估其结果的准确性和可靠性,并并无需完全依赖于 AI 工具。此次事件也呼吁建立更全面的指导方针来规范 AI 工具在法律研究中的使用,以防止类似情况的发生。