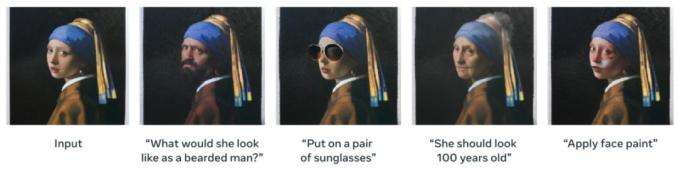

Meta公司7月14日发布出一款更高效,最先进的文本和图像生成模型CM3Leon。该是一个既可以文生图、又可以图生文的基础模型,是第一个使用从纯文本语言模型改编的配方训练的多模态模型。

Meta称,该模型在文生图方面实现了最先进的性能,同时其训练的计算量只有以前基于Transformer方法是1/5。Meta将大规模多任务指令调优应用于CM3leon,用于图像和文本生成,并表明它显著提高了图像标题生成、视觉问答、基于文本的编辑和条件图像生成等任务的性能。

以创建高质量的生成模型为目标,Meta相信CM3leon在各种任务中的强大表现是向高保真图像生成和理解迈出的一步,像CM3leon这样的模型最终可以帮助提高创造力,并在虚拟世界中提供更好的应用。

论文地址:

https://ai.meta.com/research/publications/scaling-autoregressive-multi-modal-models-pretraining-and-instruction-tuning/